Usages des IA dans les pratiques d’écriture littéraires et théâtrales : formats, processus, résultats (Lausanne)

En novembre 2022, la mise en ligne de l’agent conversationnel Chat-GPT, à partir du modèle text-davinci 003, plus couramment désigné sous l’appellation GPT 3.5, connaît un succès inattendu et largement médiatisé. Les performances du chatbot en matière de génération de contenus textuels surpassent largement ce que les internautes avaient pu connaître avec des modèles antérieurs, en anglais comme en français. Depuis, en seulement quelques années, de nombreux large language models (LLM), c’est-à-dire des programmes d’IA destinés à apprendre et produire du texte à partir de modèles prédictifs (Mistral, Deepseek, Claude...), se sont imposés sur les réseaux, offrant aux internautes de plus en plus de possibilités dans le domaine de la génération textuelle. Comment ces innovations récentes informent-elles la pratique des auteurs et autrices ? Ces programmes d’IA, souvent présentés comme des « assistants », des « outils d’aide à l’écriture », voire des « coachs », sont-ils susceptibles de modifier les pratiques d’écriture quel qu'en soit le genre littéraire ou la finalité (texte publié, performance) ? Ce sont ces mutations, en train de se faire, que ce colloque voudrait observer et prendre pour objet d’étude, en plaçant plus spécifiquement la focale sur les usages les plus intéressants que les artistes peuvent faire des IA génératives en contexte d’écriture, ainsi que sur les pratiques créatives et discursives qui en émergent.

Le colloque « Usages des IA dans les pratiques d’écriture littéraires et théâtrales : formats, processus, résultats » vient clore le programme de recherche-création ÉcrIA, mené entre mars 2025 et juin 2026 et coordonné par les universités de Lausanne, de Lyon 2 et de Grenoble-Alpes.

Axes possibles

Les axes ci-dessous peuvent être combinés. Les propositions pourront s’appuyer sur des études de cas, éventuellement nourries par des témoignages ou retours d’expérience, qui pourront résonner avec ceux conduits dans le cadre du programme ÉcrIA, ainsi que des réflexions plus transversales et théoriques. Le colloque accordera une place importante à la parole des auteurices et artistes scéniques, que la démocratisation de ces outils touche directement et interroge dans leurs pratiques, à travers des rencontres et des tables rondes.

1. Formatages et intentions d’écriture

Quand et pourquoi se tourne-t-on vers une IA générative ? À quel point le recours à une IA implique-t-il de faire des choix précoces quant au texte que l’on s’apprête à produire (nombre de signes, genres, formes, registres, tonalités, nombre de personnages, publics cibles, etc.) ? Le recours aux IA prête-t-il davantage à la production de textes d’une certaine longueur, d’un genre plutôt qu’un autre ? Dans quelle mesure les corpus d’entraînement privilégient-ils des formats ou des contenus plutôt que d’autres ? De nombreux artistes choisissent aujourd’hui de nourrir des modèles à partir de leur propre corpus d’entraînement : quelles implications cette méthode a-t-elle sur leur pratique d’écriture assistée ?

2. Prompt engineering : les processus d’écriture en question

La méthode du prompt engineering est désormais bien balisée pour l’écriture de contenus web, d’articles journalistiques ou académiques, de formats standardisés comme un CV ou une lettre de motivation. En témoignent le modèle PARTS (Persona / Aim / Recipients / Theme / Structure) recommandé par Google pour l’enseignement1, ainsi que les générateurs de prompts qui guident pas à pas les internautes dans l’écriture de leurs prompts2. S’applique-t-elle de la même manière dans un contexte littéraire ou artistique ? Comment les auteurs et autrices s’approprient-ils et elles ces méthodes ? À quels moments du processus les IA sont-elles mobilisées : phase d’idéation, de documentation, structuration des idées, rédaction ou encore rétroaction ? Comment leur utilisation est-elle articulée à des pratiques non assistées par les IA ?

Ce processus est-il susceptible d’évoluer selon les genres ou les finalités ? Le prompt engineering s’adapte assez bien à des productions textuelles qui obéissent à des schémas narratifs bien identifiés : c’est ce que révèle Si Rome n’avait pas chuté, où Raphaël Doan a repris à son compte cette technique pour « co-écrire » un récit uchronique avec GPT3 et 3.5. En revanche, des formes poétiques ou théâtrales en rupture avec les modèles dominants s’y plient-elles aussi aisément ?

On peut notamment opposer une approche « instructionnelle » (instructional prompt, consistant à donner des ordres précis au LLM) à une méthode dialogique ou dialectique (conversational prompt) qui lui laisse une plus grande marge de manœuvre. Peut-on aller jusqu’à parler de « prompt créatif » (creative prompt) ? Certains manuels de prompt engineering en font une catégorie à part entière, mais la limite à des instructional prompts appliqués au champ poétique et au storytelling3. Par ailleurs, le prompt engineering est désormais concurrencé par le déploiement d’agents conversationnels qui s’acquittent de tâches extrêmement précises, le Writing Assistant de Mistral ou les artefacts de Claude. Ce nouveau modèle est-il susceptible d’être employé dans un cadre littéraire ou artistique ? Il s’avère, par exemple, prometteur pour concevoir des personnages de fiction dotés d’une manière de parler ou pour délimiter l’éthos d’un narrateur.

3. Résultats et créations originales : la question de l’évaluation

Peut-on différencier un texte généré par un humain et un texte généré par une IA sur le critère de l’originalité ? Celle-ci peut se définir par les critères de la singularité et de l’innovation, par opposition à des pratiques comme le plagiat ou la compilation. Sur un plan plus proprement linguistique, elle peut aussi se définir relativement à des usages relevant du cliché ou, plus largement, susceptibles d’être qualifiés de prévisibles. Ces oppositions recouvrent-elles la distinction entre les corpus produits par des humains et ceux générés par des IA ?

Ne peut-on imaginer que la démocratisation de l’usage des IA au sein des pratiques artistiques est susceptible de désactiver la distinction entre production machinique et production humaine, tant celles-ci seraient (elles le sont déjà pour certains artistes et certaines œuvres) intriquées l’une dans l’autre ? Comment dissocier en effet ces deux productions, lorsque les artistes travaillent à partir des résultats de la machine (expertise des résultats, réécriture, compilation de plusieurs résultats, voire de plusieurs IA) ?

Au-delà des questions que pose la nécessité de distinguer les résultats de la machine de ceux produits par des humains, on pourra s’interroger sur la valeur accordée à ces résultats : en quoi une production humaine aurait-elle une valeur supérieure à une production machinique ? Pourquoi et sur quels critères (artistique, esthétique, d’authenticité, …) la lui accorder ? Les « performances » de la machine ne sont-elles pas propres, dans de nombreux cas, à égaler un certain nombre de productions artistiques humaines ?

4. Écriture assistée et plurimédialité : le recours aux GAN

Même si ce colloque entend se focaliser sur les LLM, il peut être intéressant d’examiner les relations entre pratique d’écriture et IA générant du contenu multimédia (GAN - Generative Adversarial Networks). Par exemple, on peut générer une image non pour illustrer un texte, mais comme source d’inspiration à part entière, par exemple pour visualiser un objet, un paysage, etc., informant une description à écrire. De même, pour la poésie, on peut mettre en musique le texte écrit pour expérimenter son rendu sous forme performative, avec l’aide de Suno, par exemple. Enfin, dans le cadre de la création scénique, on peut imaginer que le recours aux GAN présenterait des avantages considérables en termes de prévisualisation des décors par exemple, voire pour produire des éléments audiovisuels trop coûteux : c’est ce que confie par exemple Tiphaine Raffier dans le cadre de sa dernière création, la mise en scène lyrique des Dialogues des Carmélites de Francis Poulenc.

Dans un contexte économique toujours plus rude et exigeant, on peut imaginer que le recours à ces outils pourrait se démocratiser : doit-on dès lors craindre, au regard de ce qui a été énoncé plus haut sur la stéréotypisation des résultats, ainsi que du point de vue des normes morales des politiques d’utilisation, un formatage des productions artistiques et un appauvrissement des imaginaires déployés ?

5. Biais et censures : contourner les politiques d’utilisation ?

La plupart des IA génératives sont soumises à une politique d’utilisation, souvent invisible, qui empêche le modèle de générer du contenu jugé problématique (incitation à la violence, drogue, suicide, etc.). Les normes morales varient selon les entreprises et leurs codes culturels. Il est par exemple impossible de générer une image de Vénus nue dans un style néoclassique avec DALL·E (OpenAI). En revanche, l’IA française Pixtral (Mistral AI) se montre moins puritaine, considérant que la nudité n’a pas le même statut en contexte artistique que dans d’autres situations.

Dans le cadre du régime fictionnel, notamment, la politique d’utilisation d’une IA peut devenir une limite pour l’écriture, tant sur le plan thématique que stylistique : ChatGPT est incapable de générer un bon pastiche d’Aristophane, de Sade ou de Beckett. Comment les auteurs et autrices qui utilisent des LLM affrontent-ils et elles ce phénomène ? Les méthodes dites de jailbreaking (qui consistent d’ailleurs à passer par la voie de la fiction à des fins non-fictionnelles) sont-elles une option ? Au-delà du contournement, nous pouvons interroger les usages subversifs qui consistent à transformer la censure en un objet littéraire à part entière. Ainsi, en abordant la question du suicide avec ChatGPT, Milène Tournier s’est-elle heurtée au message d’erreur : « Ce contenu viole peut-être notre politique d’utilisation », qu’elle a reproduit à l’identique dans 27 fois la Muraille de Chine : je me suis posé la réponse.

Participation au colloque

Les propositions de communication, d’une longueur d’une à deux pages de texte, accompagnées d’une coutre bio-biliographie, sont à déposer avant le 30 novembre 2025, sur la plateforme SciencesConf, à partir du lien suivant : https://ecria.sciencesconf.org/.

La notification de l’acceptation des propositions aura lieu avant le 19 janvier 2026.

Le colloque aura lieu du 17 au 19 juin 2026 à l'Université de Lausanne.

Notes

[1] https://grow.google/ai-for-educators/. Voir The Five S Model (1. Set the scene ; 2. Be Specific ; 3. Simplify your language ; 4. Structure the output ; 5. Share feedback) : https://www.aiforeducation.io/ai-resources/the-five-s-model-students.

[2] Voir un modèle conçu pour les experts comptables : https://www.b-ready.team/chatgpt/generateur_de_prompts.html.

[3] Sur ce point, voir surtout la typologie des prompts proposée par Gilbert Mizrahi, Unlocking the Secrets of Prompt Engineering: Master the Art of Creative Language Generation to Accelerate Your Journey from Novice to Pro, Birminghan, Packt Publishing, 2023, p. 9-13.

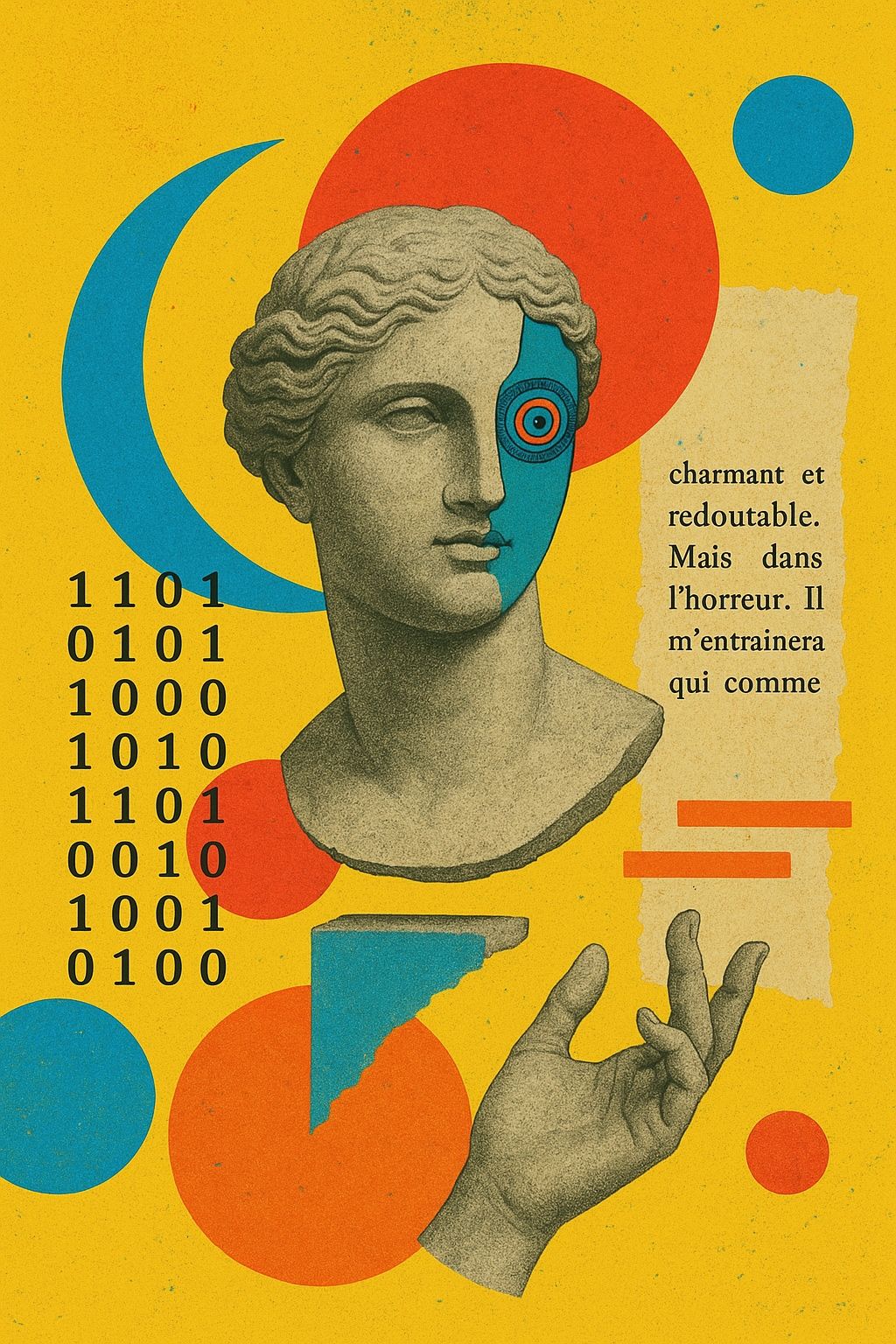

Image générée par OpenAI, ChatGPT, le 29 septembre 2025. Prompt initial : « visuel pour un colloque sur les usages de l'IA en contexte artistique, avec un côté un peu décalé, dans le genre collage, couleurs vives, poétique, des images, des suites de 1 et 0, des textes littéraires en français ».